Construyendo centros de datos modernos

Arquitecturas HyperEscalables

Las arquitecturas que se usan en los centros de datos han ido evolucionando con el paso de los años a medida que las necesidades han ido cambiando.

En un principio, se usaba una arquitectura distribuida que consistía en dividir la red en distintas capas: la capa de acceso, la capa de distribución y la capa central. La capa de acceso es donde se conectan todos los dispositivos finales. Estos dispositivos están conectados a la capa de distribución la cual se encarga de conectar la capa de acceso con la capa central donde se encaminan los paquetes muy rápidamente.

En un principio la mayor parte del tráfico iba desde el servidor final hasta fuera del centro de datos (tráfico norte – sur). Con este tipo de tráfico esta arquitectura funcionaba muy bien.

Con el paso de los años y debido a la virtualización, la mayor parte del tráfico que se genera en un centro de datos va desde un servidor a otro, es decir, hay mucho más tráfico interno (tráfico este – oeste) que saliente y entrante.

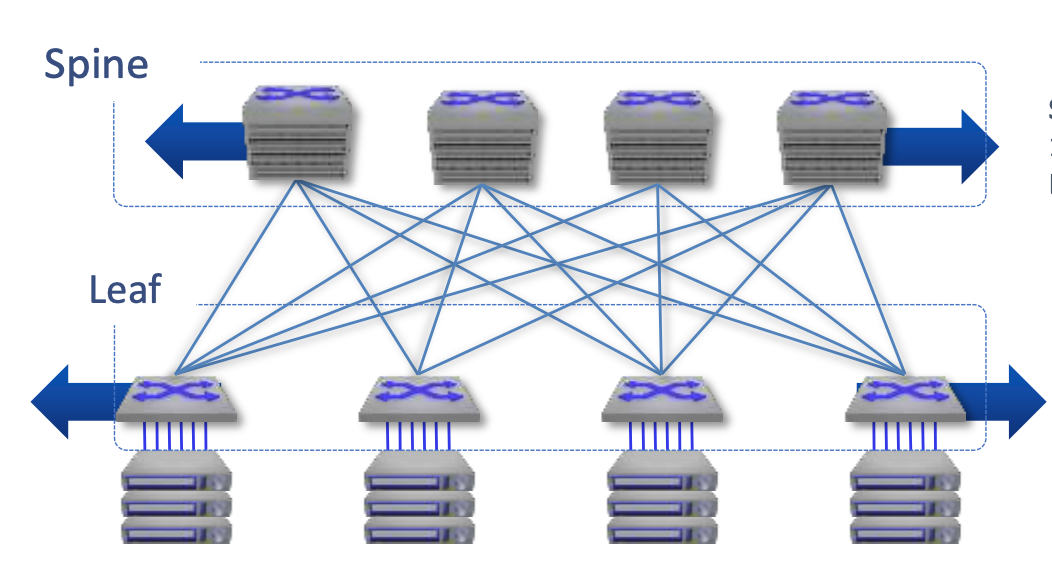

Por este motivo, salió una nueva arquitectura conocida como leaf-spine. En esta arquitectura todos los switch están conectados entre ellos y se encamina a nivel 3 (eliminado los problemas que conlleva usar STP). Gracias a esta arquitectura, el tráfico interno se puede transmitir más rápidamente, se usan todos los recursos que la red ofrece (no se usa STP) y se permite que la red sea muy escalable ya que puede crecer mucho y no resulta complicado añadir nuevos dispositivos.

Arquitectura spine-leaf

Overlay vs Underlay

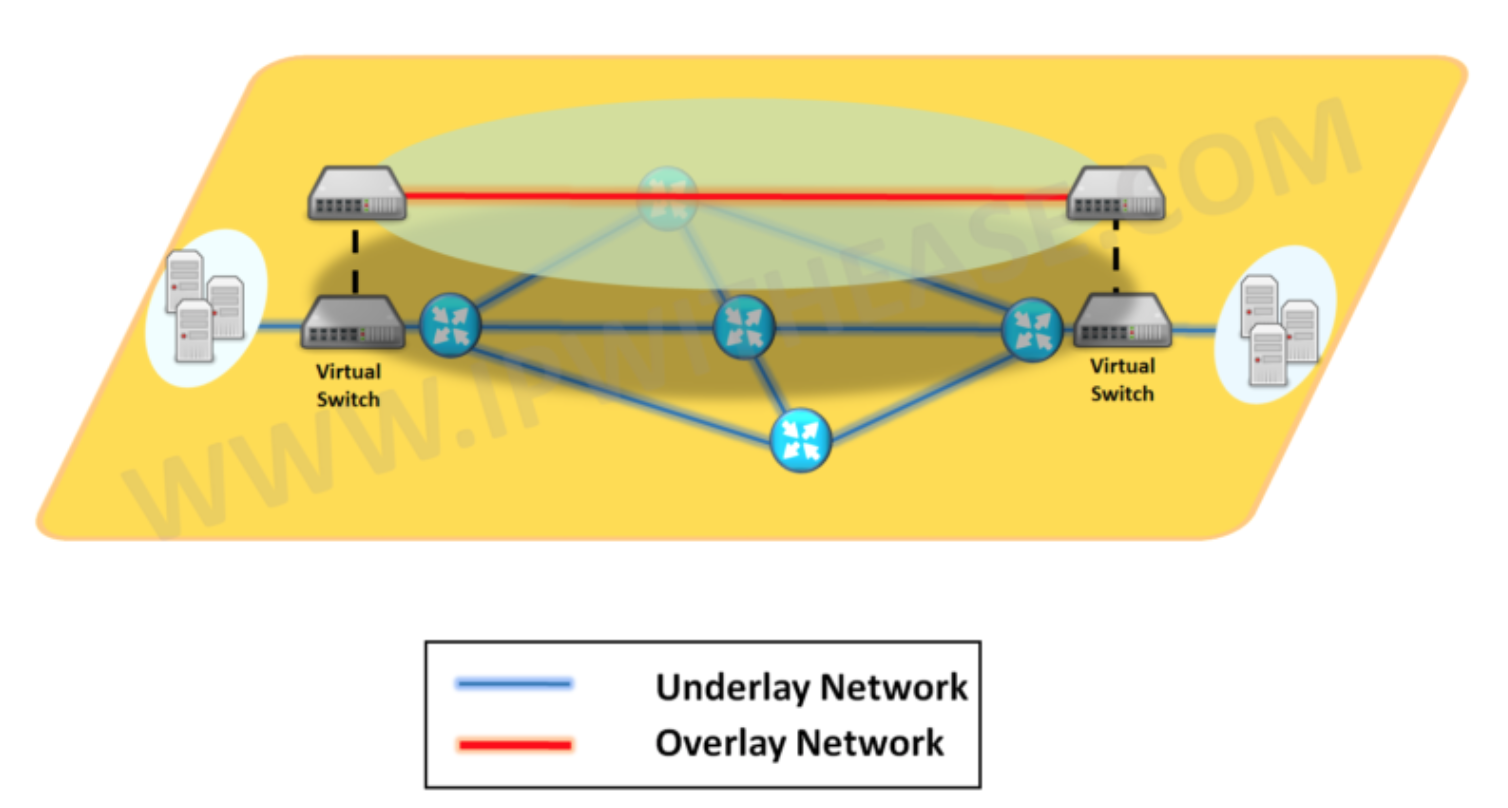

La red underlay es la infraestructura física sobre la cual se construye la red overlay. Es la red subyacente responsable de la entrega de paquetes a través de las redes.

La red overlay es una red virtual que se construye sobre una infraestructura de red subyacente. De esta forma, la red underlay proporciona un “servicio” a la red overlay.

La ventaja de trabajar con la red overlay es que no se tiene dependencia física.

Automatización

Antes de la aparición de las APIs (Application Programming Interface) suponía una gran inversión de tiempo automatizar tareas ya que, si se daba un mínimo cambio, el código cambiaba por completo.

DevOps (desarrollo y operaciones) es una práctica de la ingeniería del software que tiene como objetivo unificar el desarrollo del software y la operación del software. DevOps defiende enérgicamente la monitorización y el monitoreo en todos los pasos de la construcción del software. Gracias a esta práctica, se puede recortar el tiempo de corrección de erratas y de recuperación en caso de caída del sistema.

Dentro de la automatización Ansible es una plataforma de software libre para configurar y administrar ordenadores muy conocida. Ansible permite automatizar el aprovisionamiento del software, la gestión de configuraciones y el despliegue de aplicaciones y resulta muy útil para los administradores de sistema y DevOps.

Ansible es compatible con Linux y con Mac pero no con Windows.

Telemetría en tiempo real

Con las tecnologías que se utilizaban en el pasado, era un servidor el que iba preguntado a los distintos dispositivos en un instante del tiempo concreto si tenían algún problema. Con ese método, era muy probable que pasara algo justo en un momento en el que no se esté preguntando. Con la telemetría en tiempo real es el dispositivo que tiene un problema el que informa al servidor en tiempo real qué es lo que está ocurriendo. De este modo, es posible saber que ha pasado justo cuando esto sucede.

¿Dónde estamos y hacia dónde vamos?

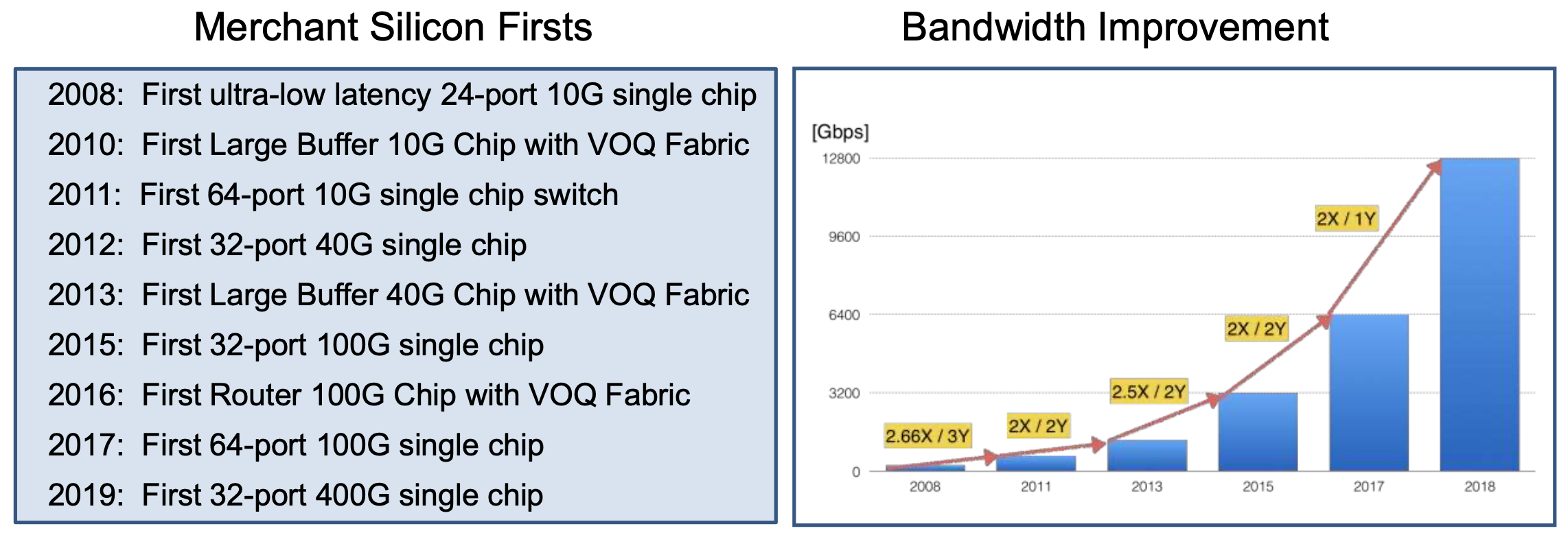

En los últimos años, la tecnología en el mundo de las redes ha evolucionado de una forma exponencial. Todo empezó entre 2008 y 2011 cuando las grandes empresas estaban creciendo a un ritmo más rápido que la propia tecnología y se vieron obligadas a fabricarse sus propios dispositivos para poder crecer. Esto conllevó que los grandes fabricantes que hasta el momento no tuvieron competencia empezaran a innovar para hacer frente a las empresas que se fabricaban sus propios dispositivos. Gracias a esta competencia se pasó de tener dispositivos de 24 puertos de 10Gb cada uno en 2008 a tener dispositivos de 32 puertos de 400Gb cada uno en 2019. Actualmente ya se está trabajando en dispositivos que tengan velocidades de 800Gb por puerto.